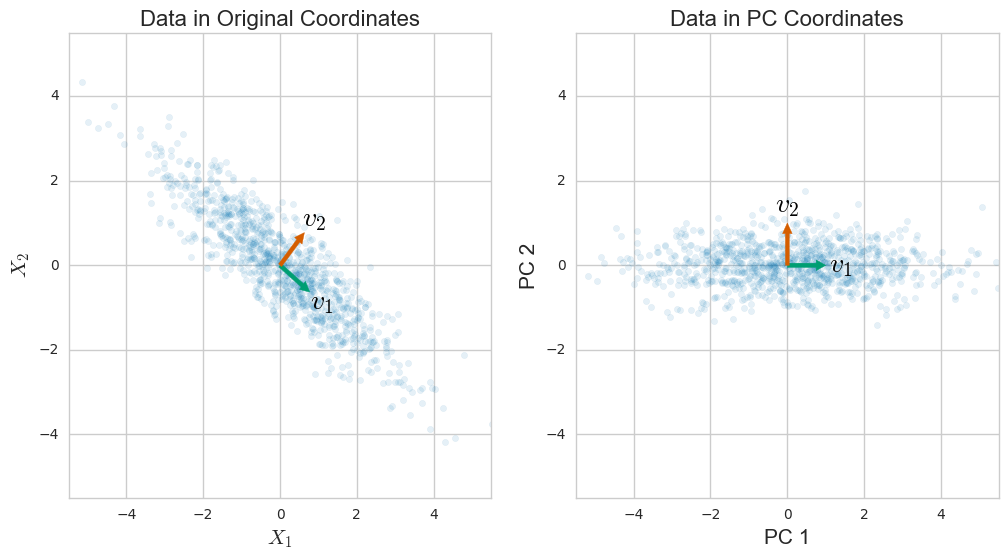

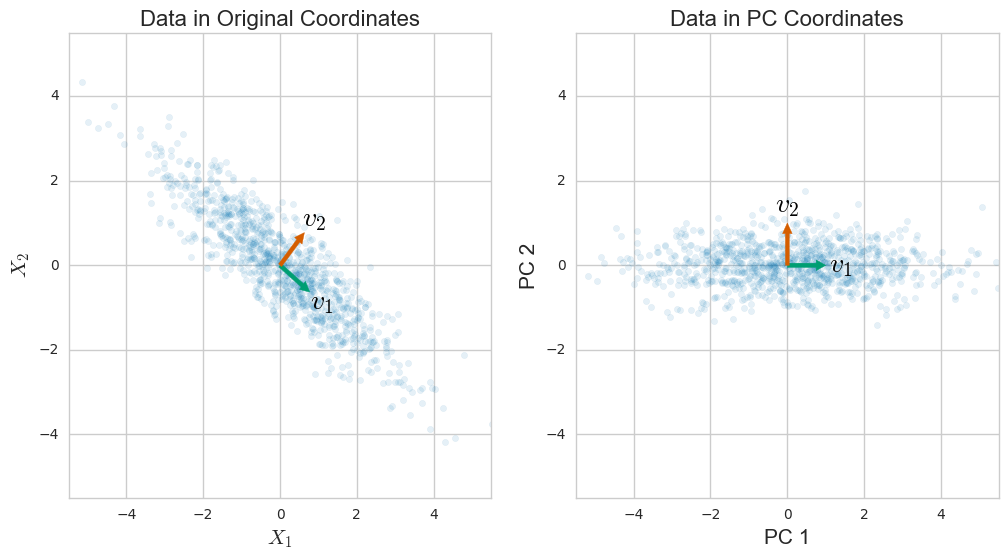

Permettez-moi de commencer par PCA. Supposons que vous avez n points de données composés de d nombres (ou dimensions) chacun. Si vous centrez ces données (soustrayez le point de données moyen de chaque vecteur de données ), vous pouvez empiler les données pour créer une matrice.μxi

X=⎛⎝⎜⎜⎜⎜⎜⎜xT1−μTxT2−μT⋮xTn−μT⎞⎠⎟⎟⎟⎟⎟⎟.

La matrice de covariance

S=1n−1∑i=1n(xi−μ)(xi−μ)T=1n−1XTX

mesures dans quelle mesure les différentes coordonnées dans lesquelles vos données sont données varient ensemble. Il n’est donc peut-être pas surprenant que l’ACP - conçue pour capturer la variation de vos données - puisse être donnée en termes de matrice de covariance. En particulier, la décomposition en valeurs propres de s’avère êtreS

S=VΛVT=∑i=1rλivivTi,

où est la ième composante principale , ou PC, et est la ième valeur propre de et est égale à la variance des données le long du ième PC. Cette décomposition découle d'un théorème général en algèbre linéaire, et un travail doit être effectué pour motiver le relatino à l'APC.viiλiiSi

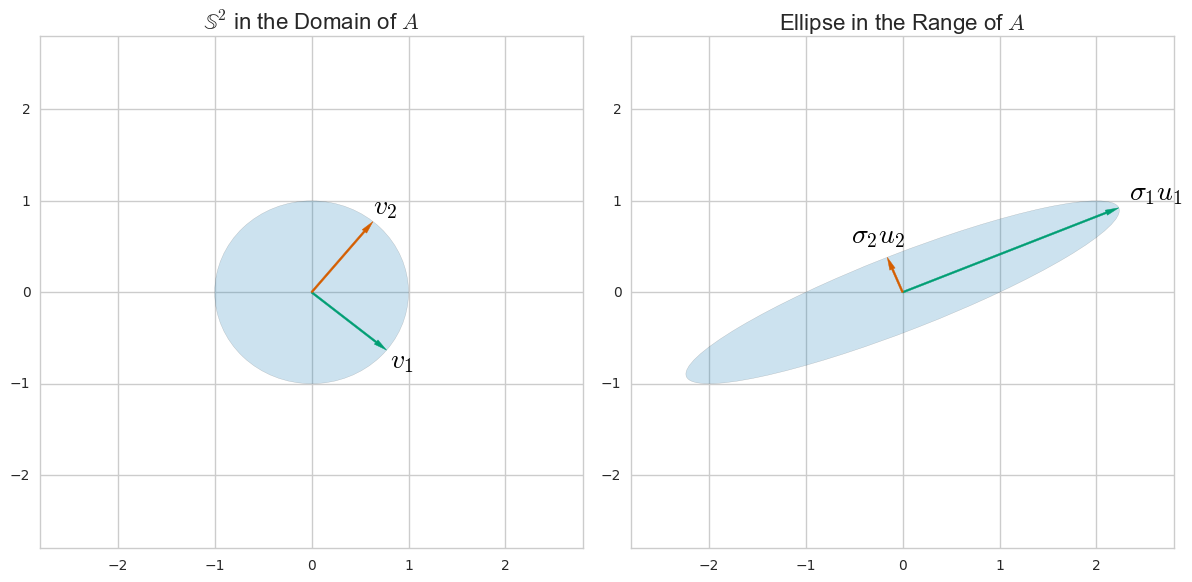

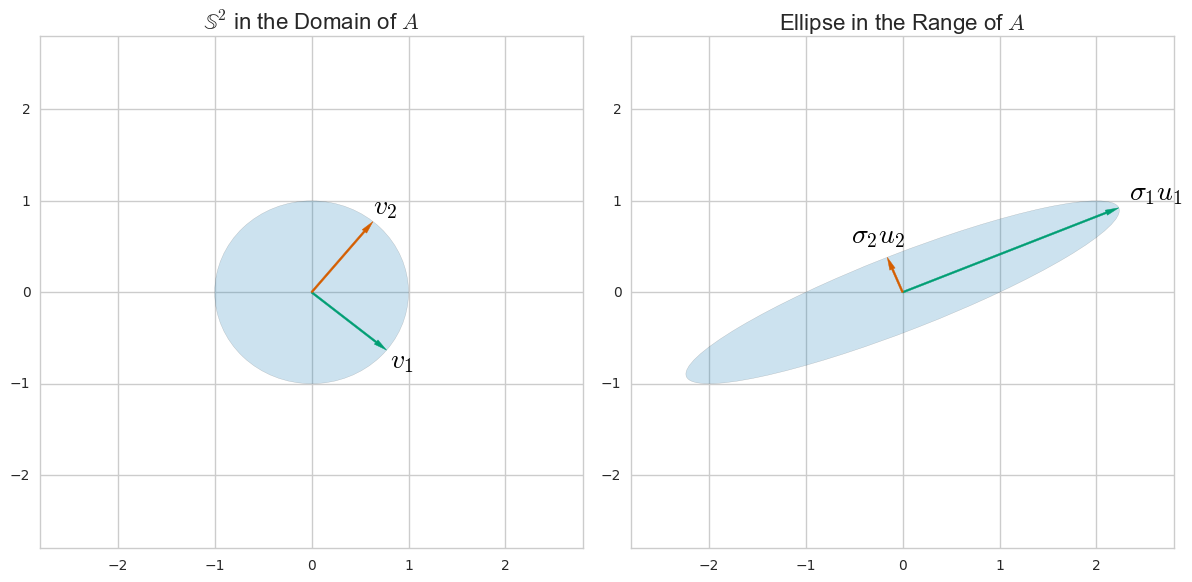

SVD est un moyen général de comprendre une matrice en termes d’espace colonne et rangée. (C'est un moyen de réécrire n'importe quelle matrice en termes d'autres matrices avec une relation intuitive à l'espace des lignes et des colonnes.) Par exemple, pour la matrice nous pouvons trouver les directions et dans le domaine et la plageA=(1021)uivi

Vous pouvez les trouver en considérant comment tant que transformation linéaire, transforme une sphère unité dans son domaine en une ellipse: les demi-axes principaux de l'ellipse alignés sur le et le sont leurs pré-images.ASuivi

Dans tous les cas, pour la matrice de données ci-dessus (en réalité, définissez simplement ), SVD nous permet d’écrireXA=X

X=∑i=1rσiuivTj,

où et sont des ensembles de vecteurs orthonormés.Une comparaison avec la décomposition en valeurs propres de révèle que les "vecteurs singuliers droits" sont égaux aux PC, les "vecteurs singuliers droits" sont{ v i } S v i{ui}{vi}Svi

ui=1(n−1)λi−−−−−−−−√Xvi,

et les "valeurs singulières" sont liées à la matrice de données viaσi

σ2i=(n−1)λi.

Il est un fait général que les vecteurs singuliers couvrent l'espace des colonnes de . Dans ce cas particulier, nous donne une projection échelonnée des données sur la direction de la ième composante principale. Les vecteurs singuliers de gauche couvrent en général l’espace de rangée de , ce qui nous donne un ensemble de vecteurs orthonormés qui recouvrent les données de la même manière que les ordinateurs personnels. x u i x i v i xuiXuiXiviX

Je vais dans quelques détails plus et avantages de la relation entre PCA et SVD dans cet article plus long .